Anton Cherepanov siempre está buscando algo interesante. Y a finales de agosto del año pasado, se dio cuenta precisamente de eso. Era un archivo subido a VirusTotal, un sitio que los investigadores de ciberseguridad como él utilizan para analizar los envíos en busca de posibles virus y otros tipos de software malicioso, a menudo conocido como malware. A primera vista parecía inofensivo, pero desencadenó las medidas personalizadas de detección de malware de Cherepanov. Durante las siguientes horas, él y su colega Peter Strýček inspeccionaron la muestra y se dieron cuenta de que nunca antes habían encontrado algo parecido.

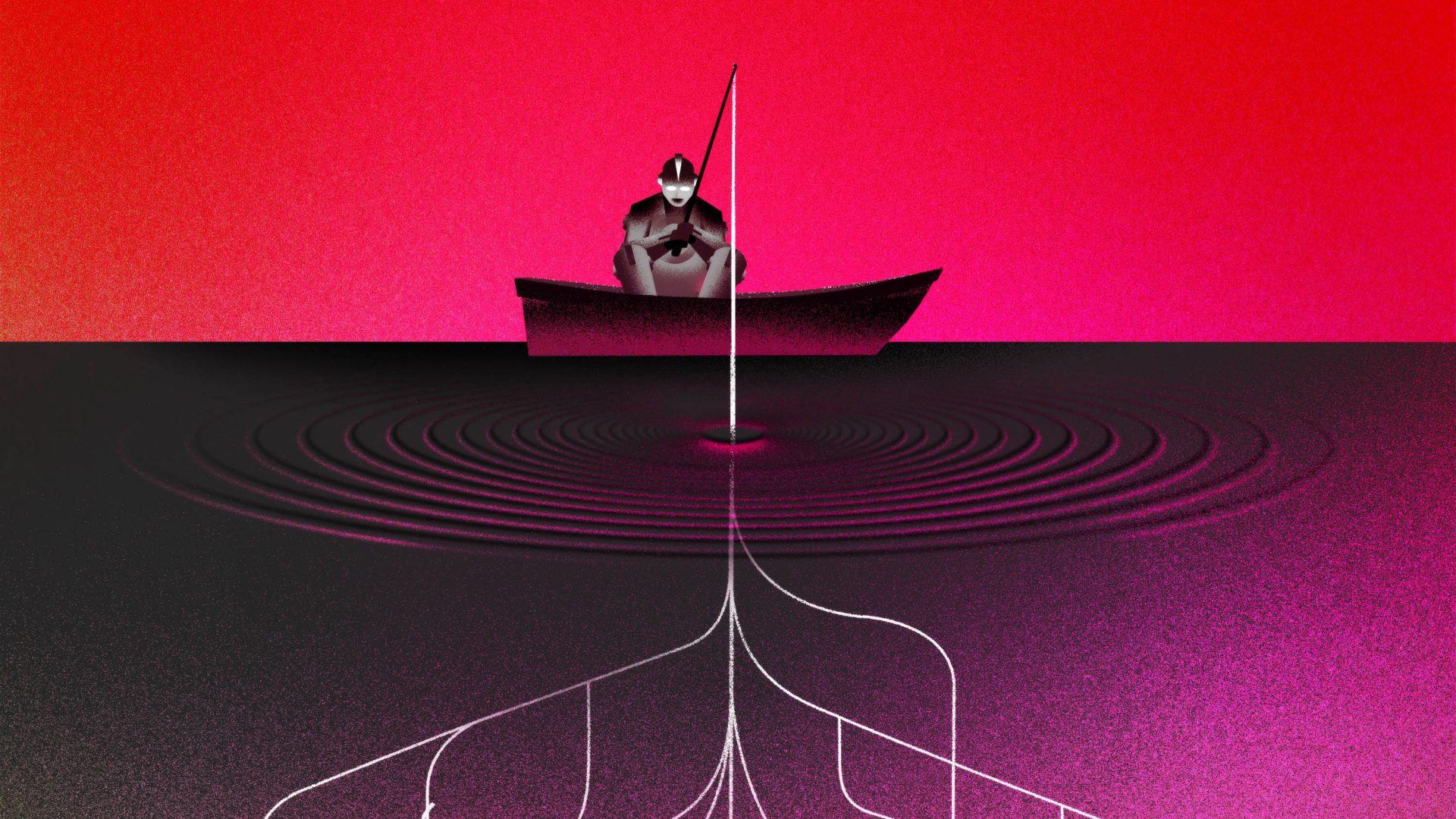

Cherepanov y Strýček confiaban en que su descubrimiento, al que denominaron PromptLock, marcaría un punto de inflexión en la IA generativa, mostrando cómo se podría explotar la tecnología para crear ataques de malware altamente flexibles. Publicaron un entrada del blogBRIAN STAUFFER

Pero los malos actores no se centran sólo en tratar de doblegar los modelos de los gigantes de la IA para sus nefastos fines. En el futuro, es cada vez más probable que adopten modelos de IA de código abierto

Sin embargo, las cinco familias de malware que analizó el informe (incluido PromptLock) consistían en código que se detectaba fácilmente y en realidad no causaba ningún daño, señaló el escritor de ciberseguridad Kevin Beaumont en redes socialesBRIAN STAUFFER

A pesar del constante cambio en el panorama de la ciberseguridad, Jess se siente alentada por la facilidad con la que los defensores comparten información detallada entre sí sobre las tácticas de los atacantes. El panorama de amenazas adversas de Mitre para los sistemas de inteligencia artificial

Publicado originalmente en technologyreview.com el 12 de febrero de 2026.

Ver fuente original